【行业】AI芯片-AI领强算力时代GPU启新场景(80页)

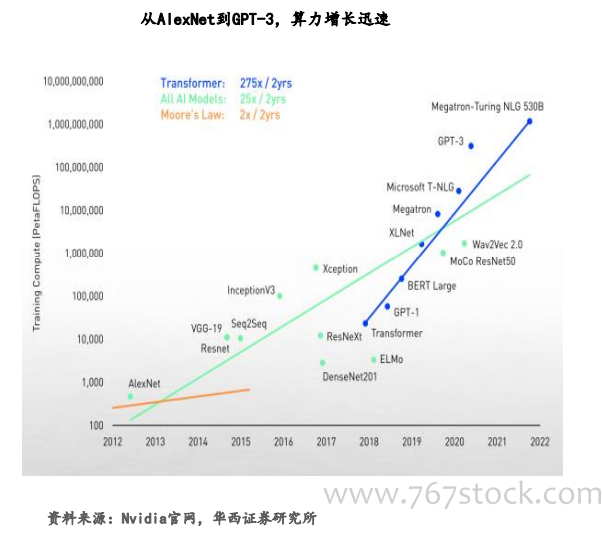

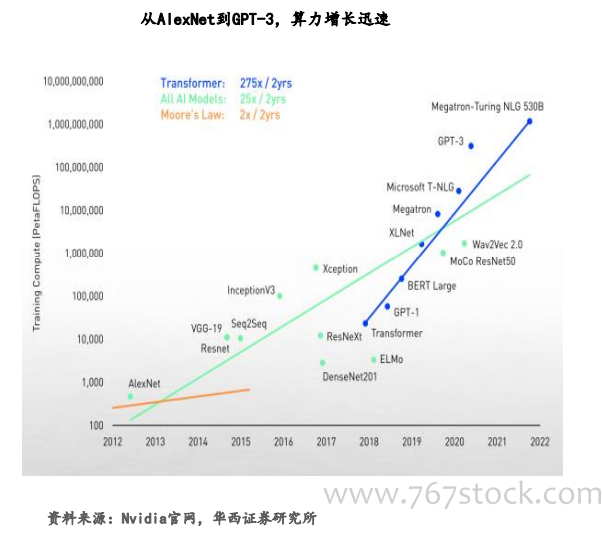

GPT-3模型目前已入选了《麻省理工科技评论》2021年“十大突破性技术。 GPT-3的模型使用的最大数据集在处理前容量达到了45TB。根据 OpenAI的算力统计单位petaflops/s-days,训练AlphaGoZero需要1800-2000pfs-day,而GPT-3用了3640pfs-day。 AI运算指以“深度学习” 为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等)。需要硬件具有高效的线性代数运算能力,计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。

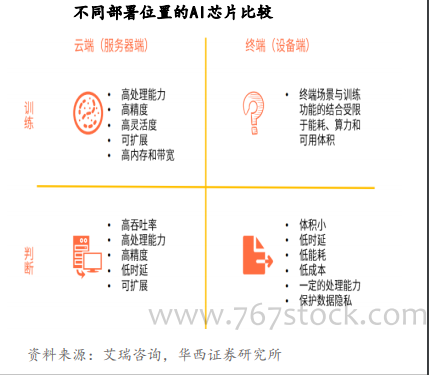

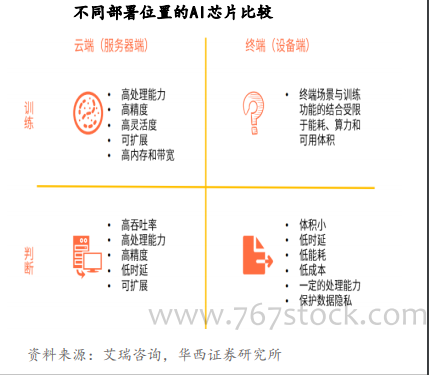

AI运算指以“深度学习” 为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等)。需要硬件具有高效的线性代数运算能力,计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。 根据机器学习算法步骤,可分为训练(training)芯片和推断(inference)芯片。训练芯片主要是指通过大量的数据输入,构建复杂的深度神经网络模型的一种AI芯片,运算能力较强。推断芯片主要是指利用训练出来的模型加载数据,计算“推理”出各种结论的一种AI芯片,侧重考虑单位能耗算力、时延、成本等性能。

根据机器学习算法步骤,可分为训练(training)芯片和推断(inference)芯片。训练芯片主要是指通过大量的数据输入,构建复杂的深度神经网络模型的一种AI芯片,运算能力较强。推断芯片主要是指利用训练出来的模型加载数据,计算“推理”出各种结论的一种AI芯片,侧重考虑单位能耗算力、时延、成本等性能。

AI运算指以“深度学习” 为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等)。需要硬件具有高效的线性代数运算能力,计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。

AI运算指以“深度学习” 为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等)。需要硬件具有高效的线性代数运算能力,计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。 根据机器学习算法步骤,可分为训练(training)芯片和推断(inference)芯片。训练芯片主要是指通过大量的数据输入,构建复杂的深度神经网络模型的一种AI芯片,运算能力较强。推断芯片主要是指利用训练出来的模型加载数据,计算“推理”出各种结论的一种AI芯片,侧重考虑单位能耗算力、时延、成本等性能。

根据机器学习算法步骤,可分为训练(training)芯片和推断(inference)芯片。训练芯片主要是指通过大量的数据输入,构建复杂的深度神经网络模型的一种AI芯片,运算能力较强。推断芯片主要是指利用训练出来的模型加载数据,计算“推理”出各种结论的一种AI芯片,侧重考虑单位能耗算力、时延、成本等性能。